视觉跟踪是计算机视觉领域中的一个富有挑战的基础研究课题[1],在人机交互、机器人、视频监控和运动分析等领域有着广泛的应用前景。视觉跟踪的目的是跟踪视频每一帧中目标呈现的外观和状态变化。在跟踪任务中会遇到很多技术难点,包括光照变化、局部遮挡、运动模糊、背景杂乱和姿态变化等。国内外学者针对这些挑战提出了很多跟踪算法[1–4],但设计一个快速鲁棒的视觉跟踪算法仍是当今研究的热点。

跟踪算法可以分为判别模型和生成模型,判别模型是二值分类问题,需要设计1个区分目标和背景的鲁棒分类器;生成模型是选出与目标具有最小重建误差的样本,即寻找与目标相似度最大的候选粒子。近年来,基于稀疏表示的生成模型跟踪算法受到了广泛关注。Mei等[5]提出的L1跟踪算法把目标表示为模板字典的稀疏近似,并用琐碎模板处理遮挡,该方法虽然对遮挡有较好的鲁棒性,但求解L1最小化问题速度较慢,不能满足跟踪的实时性。Bao等[6]对目标模板系数实施L1范数正则化约束,对琐碎模板系数进行L2范数约束,并使用高效的梯度下降优化算法,提高了L1跟踪的速度和精度。Jia等[7]提出自适应结构化局部稀疏外观(adaptive structural local sparse appearance, ASLSA)模型,对表示系数进行对准池和平均化操作,很好地利用了目标的局部和空间结构信息,提高了跟踪的准确度。Xiao等[8]用主成分分析(principal component analysis, PCA)基向量和平方模板分别为目标和遮挡建模,并对2个表示系数同时进行L2范数正则化最小二乘(L2 regularized least square,L2RLS)处理,减小了跟踪的计算复杂度。虽然这些算法有较好的跟踪速度并对遮挡有一定的鲁棒性,但是此类跟踪算法都是单独地求解每个候选粒子的表示系数,忽略了粒子间潜在的约束关系,因而跟踪精度有待提高。

为了充分利用候选粒子间的内在关系,Zhang等[9]把低秩表示(low-rank representation,LRR)引入到视觉跟踪领域,把跟踪看作是低秩矩阵的学习问题,大大提高了跟踪的准确度。王海军等[10]把固定帧的跟踪结果作为观测矩阵,采用增量鲁棒PCA模型求解观测矩阵的低秩特征,该算法虽然提高了跟踪的鲁棒性,但没有考虑表示系数的稀疏性导致跟踪精度不高。

基于以上的分析,作者提出在线低秩稀疏表示的鲁棒视觉跟踪。首先采用PCA降维的方法获取少量基向量作为目标模板,并对PCA基模板系数和琐碎模板系数施加低秩稀疏约束,两者结合共同表示目标的外观变化。其次利用建立的观测模型计算似然概率,确定最优候选粒子并按要求进行存储,再采用增量PCA方法对存储的粒子进行处理实现模板更新。在粒子滤波框架下,结合提出的低秩稀疏算法实现了目标跟踪,实验结果显示,本文提出的算法具有较好的跟踪性能。

1 低秩稀疏表示模型在跟踪过程中,目标外观的变化存在于一个低维子空间。文献[9]中的模板是在目标周围随机采样的图像块,具有高度的相关性,因此它们包含的信息是重复的而不足以表示整个目标子空间。这样的模板组合只能表示与其类似的目标,一旦发生跟踪漂移用错误的跟踪结果更新模板后,跟踪器会很难纠正自身错误使其恢复到正确跟踪。文献[11]中采用低维的PCA子空间作为目标模板,模板之间彼此独立,充分利用了PCA基向量对目标的表示能力。因此本文以PCA基向量模板描述目标外观,并用琐碎模板处理目标中出现的部分遮挡,把观测目标表示为:

| $\mathit{\boldsymbol{Y}} = \mathit{\boldsymbol{UX}} + \mathit{\boldsymbol{E}} = \left[ {\mathit{\boldsymbol{U}}\;\;\mathit{\boldsymbol{I}}} \right]\left[ \begin{array}{l}\mathit{\boldsymbol{X}}\\\mathit{\boldsymbol{E}}\end{array} \right] = \mathit{\boldsymbol{DC}}\;\;\;{\rm{s.t.}}\;{\mathit{\boldsymbol{U}}^{\rm T}}\mathit{\boldsymbol{U}} = \mathit{\boldsymbol{I}}$ | (1) |

式中:

由于候选粒子是在前一帧跟踪结果周围采样得到的,则表示系数比较相似,因此PCA基模板系数X具有低秩稀疏性,建模遮挡或噪声的稀疏误差项E具有稀疏性。因此低秩稀疏表示模型由低秩表示、稀疏表示和重建误差3部分组成,表示系数的优化问题如式(2)所示:

| $\mathop {\min }\limits_{X,E} \;{\lambda _1}{\left\| \mathit{\boldsymbol{X}} \right\|_ * } + {\lambda _2}{\left\| \mathit{\boldsymbol{X}} \right\|_{1,1}} + {\lambda _3}{\left\| \mathit{\boldsymbol{E}} \right\|_{1,1}}$ | (2) |

式中:

为了求解表示系数矩阵X和E,需要在式(2)的基础上引入2个松弛变量和等式约束,将其转化为等价式(3):

| $\begin{aligned}& \mathop {\min }\limits_{{X_1},{X_2},{X_3},E} \;{\lambda _1}{\left\| {{\mathit{\boldsymbol{X}}_1}} \right\|_ * } + {\lambda _2}{\left\| {{\mathit{\boldsymbol{X}}_2}} \right\|_{1,1}} + {\lambda _3}{\left\| \mathit{\boldsymbol{E}} \right\|_{1,1}}\\& \quad {\rm{s.t.}}\;\mathit{\boldsymbol{Y}} = \mathit{\boldsymbol{U}}{\mathit{\boldsymbol{X}}_3} + \mathit{\boldsymbol{E}},{\mathit{\boldsymbol{X}}_3} = {\mathit{\boldsymbol{X}}_1},{\mathit{\boldsymbol{X}}_3} = {\mathit{\boldsymbol{X}}_2}\end{aligned}$ | (3) |

然后把等式约束合并到目标函数中,得到无约束的拉格朗日函数:

| $\begin{aligned}[b]\! \! \! \! \! \,L({\mathit{\boldsymbol{X}}_{1 - 3}},& \mathit{\boldsymbol{E}},{\mathit{\boldsymbol{M}}_{1 - 3}},{\mu _{1 - 3}}) \! = \! {\lambda _1}{\left\| {{\mathit{\boldsymbol{X}}_1}} \right\|_ * } \! + \! {\lambda _2}{\left\| {{\mathit{\boldsymbol{X}}_2}} \right\|_{1,1}} \! + \! {\lambda _3}{\left\| \mathit{\boldsymbol{E}} \right\|_{1,1}}\! + \! \! \! \\& {\rm tr}\left[ {\mathit{\boldsymbol{M}}_1^{\rm T}(\mathit{\boldsymbol{Y}} - \mathit{\boldsymbol{U}}{\mathit{\boldsymbol{X}}_3} - \mathit{\boldsymbol{E}})} \right] + \frac{{{\mu _1}}}{2}\left\| {\mathit{\boldsymbol{Y}} - \mathit{\boldsymbol{U}}{\mathit{\boldsymbol{X}}_3} - \mathit{\boldsymbol{E}}} \right\|_F^2+ \! \! \! \\& {\rm tr}\left[ {\mathit{\boldsymbol{M}}_2^{\rm T}({\mathit{\boldsymbol{X}}_3} - {\mathit{\boldsymbol{X}}_1})} \right] + \frac{{{\mu _2}}}{2}\left\| {{\mathit{\boldsymbol{X}}_3} - {\mathit{\boldsymbol{X}}_1}} \right\|_F^2 + \\& {\rm tr}\left[ {\mathit{\boldsymbol{M}}_3^{\rm T}({\mathit{\boldsymbol{X}}_3} - {\mathit{\boldsymbol{X}}_2})} \right] + \frac{{{\mu _3}}}{2}\left\| {{\mathit{\boldsymbol{X}}_3} - {\mathit{\boldsymbol{X}}_2}} \right\|_F^2\end{aligned}$ | (4) |

式中,

| $\mathop {\min }\limits_{{\mathit{\boldsymbol{X}}_{1 - 3}},\mathit{\boldsymbol{E}},{\mathit{\boldsymbol{M}}_{1 - 3}},{\mu _{1 - 3}}} L({\mathit{\boldsymbol{X}}_{1 - 3}},\mathit{\boldsymbol{E}},{\mathit{\boldsymbol{M}}_{1 - 3}},{\mu _{1 - 3}})$ | (5) |

式(5)可采用非精确增广拉格朗日乘子(inexact augmented lagrange multiplier, IALM)方法迭代求解,每次迭代仅更新一个变量而保持其他变量固定不变,然后交替迭代求解各个变量,直至最后满足收敛条件时结束。具体如方法1所述,其中

方法1 表示系数的求解步骤

输入:样本粒子矩阵Y,PCA基模板矩阵U,参数

1)初始化

2)固定其他变量,更新X1:

3)固定其他变量,更新X2:

4)固定其他变量,更新E:

5)固定其他变量,更新X3:

| $\begin{aligned}{\mathit{\boldsymbol{X}}_3} & = {({\mathit{\boldsymbol{U}}^{\rm T}}\mathit{\boldsymbol{U}} + \frac{{{\mu _2}}}{{{\mu _1}}}\mathit{\boldsymbol{I}} \! + \! \frac{{{\mu _3}}}{{{\mu _1}}}\mathit{\boldsymbol{I}})^{ - 1}} \times \\& \quad \left[ {{\mathit{\boldsymbol{U}}^{\rm T}}(\mathit{\boldsymbol{Y}} \! - \! \mathit{\boldsymbol{E}}) \! + \! \frac{{{\mu _2}}}{{{\mu _1}}}{\mathit{\boldsymbol{X}}_1} \! + \! \frac{{{\mu _3}}}{{{\mu _1}}}{\mathit{\boldsymbol{X}}_2} \! + \! \frac{{{\mathit{\boldsymbol{U}}^{\rm T}}{\mathit{\boldsymbol{M}}_1} - {\mathit{\boldsymbol{M}}_2} \! - \! {\mathit{\boldsymbol{M}}_3}}}{{{\mu _1}}}} \right]\text{。}\end{aligned}$ |

6)更新乘子M1、M2、M3和惩罚参数

| $\left\{ \begin{array}{l}\! \! {{\mathit{\boldsymbol{M}}}_1} = {{\mathit{\boldsymbol{M}}}_1} + {\mu _1}\left( {{\mathit{\boldsymbol{Y}}} - {{\mathit{\boldsymbol{UX}}}_3} - {\mathit{\boldsymbol{E}}}} \right)\\[2pt]\! \! {{\mathit{\boldsymbol{M}}}_2} = {{\mathit{\boldsymbol{M}}}_2} + {\mu _2}\left( {{{\mathit{\boldsymbol{M}}}_3} - {{\mathit{\boldsymbol{M}}}_1}} \right)\\[2pt]\! \! {{\mathit{\boldsymbol{M}}}_3} = {{\mathit{\boldsymbol{M}}}_3} + {\mu _3}\left( {{{\mathit{\boldsymbol{M}}}_3} - {{\mathit{\boldsymbol{M}}}_2}} \right)\end{array} \right.,\left\{ \begin{array}{l}\! {\mu _1} = \min \left( {\rho {\mu _1},{\mu _{\max }}} \right)\\[2pt]\! {\mu _2} = \min \left( {\rho {\mu _2},{\mu _{\max }}} \right){\text{。}}\\[2pt]\! {\mu _3} = \min \left( {\rho {\mu _3},{\mu _{\max }}} \right)\end{array} \right.$ |

7)

8)令

粒子滤波是贝叶斯顺序重要性抽样方法,作者基于粒子滤波的方法来跟踪目标,主要包括2个重要的步骤:预测和更新。给定从1到t–1时刻的1组观测图像

| $p({\mathit{\boldsymbol{z}}_t}|{\mathit{\boldsymbol{y}}_{1:t - 1}}) = \int {P({\mathit{\boldsymbol{z}}_t}|{\mathit{\boldsymbol{z}}_{t - 1}})} P({\mathit{\boldsymbol{z}}_{t - 1}}|{\mathit{\boldsymbol{y}}_{1:t - 1}}){{\rm d}z}_{t - 1}$ | (6) |

式中,

| $P({\mathit{\boldsymbol{z}}_t}|{\mathit{\boldsymbol{z}}_{t - 1}}){\rm{ = }}N({\mathit{\boldsymbol{z}}_t};{\mathit{\boldsymbol{z}}_{t - 1}},\mathit{\boldsymbol{\psi }})$ | (7) |

式中:状态向量

当获得t时刻的候选粒子

| $p({{z}_t}|{\mathit{\boldsymbol{y}}_{1:t}}) = \frac{{P({\mathit{\boldsymbol{y}}_t}|{{\mathit{\boldsymbol{z}}}_t})p({\mathit{\boldsymbol{z}}_t}|{\mathit{\boldsymbol{y}}_{1:t - 1}})}}{{p({\mathit{\boldsymbol{y}}_t}|{\mathit{\boldsymbol{y}}_{1:t - 1}})}}$ | (8) |

式中,

| $\mathop {\min }\limits_{{\mathit{\boldsymbol{X}}_t},{\mathit{\boldsymbol{E}}_t}} \;{\lambda _1}{\left\| {{\mathit{\boldsymbol{X}}_t}} \right\|_ * } + {\lambda _2}{\left\| {{\mathit{\boldsymbol{X}}_t}} \right\|_{1,1}} + {\lambda _3}{\left\| {{\mathit{\boldsymbol{E}}_t}} \right\|_{1,1}}{\rm{s.t.}}\;{\mathit{\boldsymbol{Y}}_t} = {\mathit{\boldsymbol{U}}_t}{\mathit{\boldsymbol{X}}_t} + {\mathit{\boldsymbol{E}}_t}$ | (9) |

把求得的表示系数Xt和Et代入本文的观测模型:

| $p(\mathit{\boldsymbol{y}}|\mathit{\boldsymbol{z}}) = \exp [ - \left\| {{\mathit{\boldsymbol{W}}_t} \odot ({\mathit{\boldsymbol{Y}}_t} - {\mathit{\boldsymbol{U}}_t}{\mathit{\boldsymbol{X}}_t})} \right\|_F^2 - {\lambda _3}{\left\| {{\mathit{\boldsymbol{E}}_t}} \right\|_{1,1}}]$ | (10) |

式中:W为一个指示矩阵,用于指示E中的零元素;

本文采用遮挡检测更新机制对目标模板进行更新,首先利用稀疏误差项E来检测目标遮挡,遮挡率

| $\eta = \frac{{\mathit{\boldsymbol{E}}\text{中非零值的个数}}}{{\mathit{\boldsymbol{E}}\text{中元素总个数}}}$ | (11) |

并设置两个阈值low和high,若

以粒子滤波为框架,结合运动模型、观测模型和遮挡检测更新机制得到本文的跟踪方法,具体步骤如方法2所述。

方法2 低秩稀疏表示的视觉跟踪方法

输入:目标初始状态z0和目标序列图像

1)初始化目标模板U0;

2)用运动模型式(7)采样粒子;

3)根据算法1求解粒子的表示系数,并利用式(10)计算观测似然;

4)运用最大后验概率准则估计t时刻的目标状态 zt;

5)根据遮挡检测结果,使用增量PCA方法更新PCA基模板Ut;

6)若为最后一帧则终止,否则转到2)。

4 实验结果与分析本文算法的开发工具为Matlab R2012b,在Pentium(R) Dual-Core 3.20 GHz CPU,2 G内存的PC机上对提出的跟踪方法进行实验操作。在8个视频图像序列[4]上对提出的跟踪算法进行了实验验证,并与L1[5]、IVT[11]、ASLSA[7]和L2RLS[8]这4种跟踪方法进行比较,给出了定性、定量和实时性分析。本文跟踪算法的参数设置如下:实验中的粒子数均为600且每5帧更新一次观测模型,图像观测标准化为32×32像素,PCA基向量个数设为25,琐碎模板1 024个,正则化参数

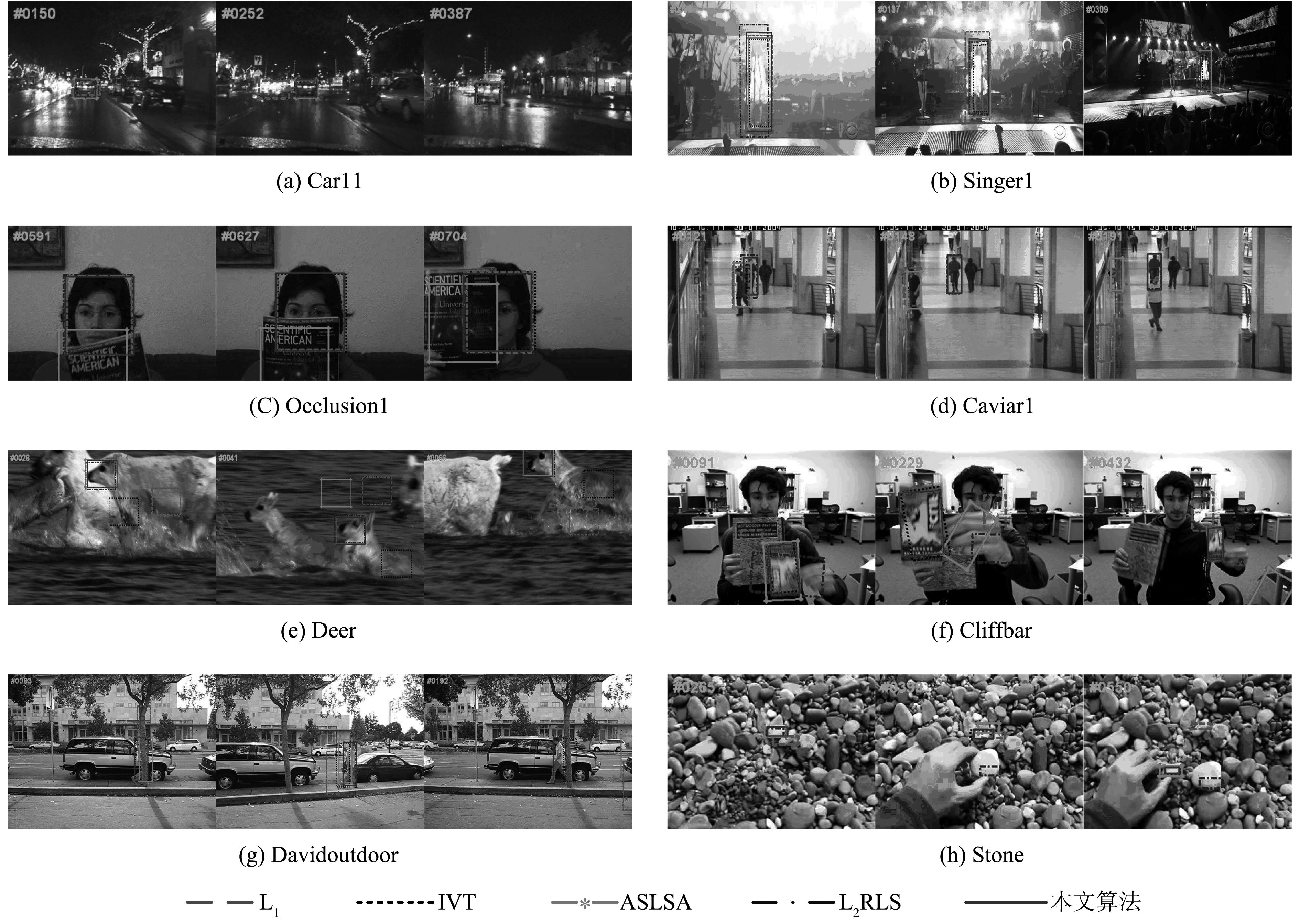

图1给出了8组测试序列在5种跟踪方法上的跟踪结果,图像中左上方的“#数字”表示跟踪结果的第几帧。Car11序列和Singer1序列中的目标都经历了比较严重的光照变化和尺度变化,图1(a)中的跟踪结果显示L1算法发生跟踪漂移(#0252),并在随后帧中逐渐移出图像窗口(#0387);图1(b)中IVT算法(#0137)跟踪的中心位置偏差较大,其他几种跟踪方法都能较准确的跟踪目标。Occlusion1序列和Caviar1序列存在较严重的目标遮挡,图1(c)中当目标被长时间遮挡时,ASLSA算法会漂移到遮挡物上(#0627、#0704)且不能自行恢复到正确跟踪;图1(d)是监控拍摄的行人,目标女士的裤子和遮挡男士的衣服颜色相似,当目标被遮挡时,L1算法、IVT算法和ASLSA算法都发生了跟踪失败现象(#0121、#0148),只有本文算法和L2RLS算法能持续准确地跟踪目标,这是因为这两种算法充分利用了PCA基模板对目标的表示能力并采用了较完善的模板更新方法。

|

| 图1 测试图像序列跟踪结果 Fig. 1 Tracking results of test image sequences |

Deer序列存在快速运动和运动模糊,从图1(e)中可以看出,L1算法在整个序列上几乎没有一帧能成功跟踪,IVT算法因无法处理噪声致使其逐渐漂移,ASLSA算法也出现了跟踪失败现象(#0041),其他两个算法跟踪精度相当;Cliffbar序列存在运动模糊、尺度变化、背景杂乱和平面内旋转等多重挑战,图1(f)中只有本文跟踪算法考虑了粒子间的低秩性而能较稳定地跟踪目标,其他几种算法都发生了跟踪失败,表明了本文算法具有较好的鲁棒性。Davidoutdoor序列中目标人物的裤子与树干、大地的颜色一致,存在杂乱背景、目标遮挡和平面外旋转,图1(g)中在目标第1次被遮挡时L1算法出现跟踪漂移(#0083),目标转身时L1算法、IVT算法和ASLSA算法均发生跟踪失败现象(#0127),即使经历第2次目标遮挡本文算法和L2RLS算法仍能准确地跟踪目标(#0192);Stone序列存在杂乱背景和目标遮挡,图1(h) 中在目标被相似物体遮挡后,L1算法和L2RLS算法发生跟踪失败(#0399),其他几种算法都有较好的跟踪准确性。

4.2 定量分析本文中目标的真实参数是通过手工标定得到,采用平均重叠率和平均中心误差[8]来定量评估以上5种算法的性能。假设目标的真实边界框为ra,跟踪算法获得的目标边界框为rt,则重叠率S定义为:

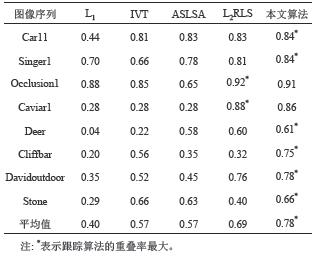

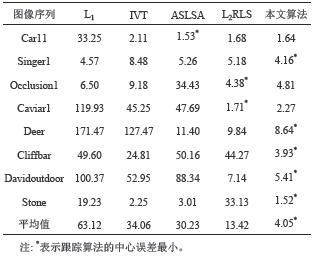

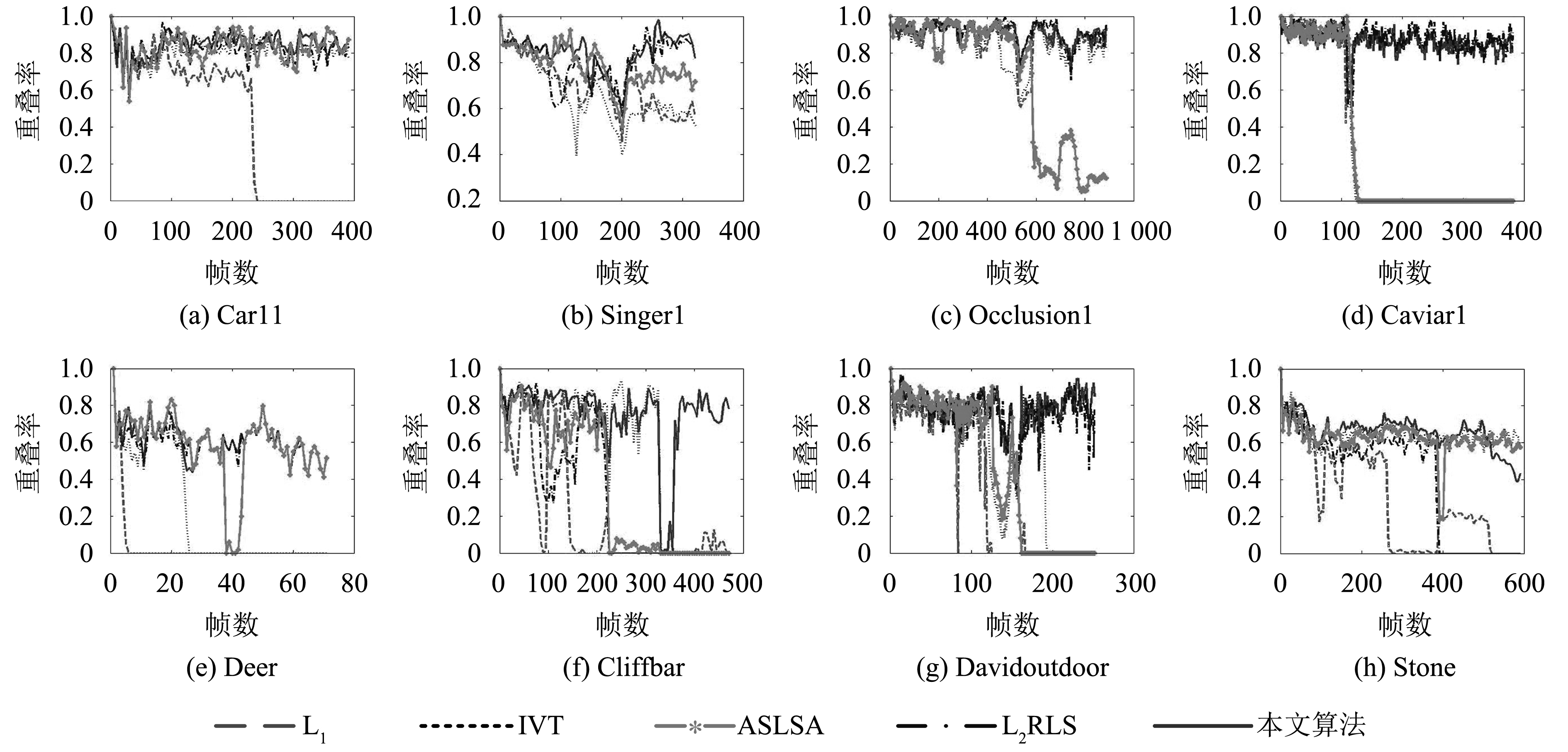

由表1可以看出,除Occlusion1和Caviar1序列外,本文算法在其他几个序列上均取得重叠率最大值,且在8组图像序列上的重叠率平均值高达0.78,表明本文算法有较好的鲁棒性。由表2可知,在Car11、Occlusion1和Caviar1序列上本文算法虽然没有得到最佳的中心误差,但与最小误差值相差很小,并在其他5个视频序列上得到中心误差最小值,且平均中心误差为4.05个像素,表示了本文算法的跟踪准确性。为方便直观比较,在图2中展示了这8组测试序列的重叠率曲线,图3中展示了中心误差曲线。由图2可以看出,本算法曲线在各序列上位于较高的位置,代表具有较高的重叠率;由图3可以看出,本算法曲线在各序列上位于较低的位置,代表具有较低的中心误差,因此可以证明本文算法有较好的跟踪鲁棒性和准确性。

| 表1 跟踪算法的平均重叠率 Tab. 1 Average overlap rate of the tracking algorithms |

|

| 表2 跟踪算法的平均中心误差 Tab. 2 Average center error of the tracking algorithms |

|

|

| 图2 重叠率曲线 Fig. 2 Curves of overlap rate |

|

| 图3 中心误差曲线 Fig. 3 Curves of center error |

4.3 实时性分析

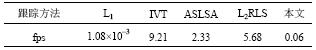

一个鲁棒的跟踪算法在保证准确性的前提下,也应满足跟踪的实时性。本文采用8组图像序列的平均帧率来评价跟踪算法的实时性,帧率指的是计算机每秒处理的帧数(frames per second,fps)。表3给出了在相同软硬件条件下,粒子数n=600、特征向量维度d=32×32时5种跟踪算法的平均帧率。由于L1算法采用内点法求解单个粒子的表示系数,使得计算复杂耗时较长,因而平均帧率最小;IVT算法的计算复杂度只涉及矩阵矢量相乘运算,处理过程比较简单,平均帧率最高;本文算法采用IALM方法和多候选粒子批处理的方法降低复杂度,因而平均帧率高于L1算法,但矩阵秩的运算涉及奇异值软阈值操作,SVD分解较为耗时,故平均帧率低于其他算法。尽管本文算法的效率比L1算法高比其他算法低,但是结合表1和表2可以看出,本算法取得了最佳的重叠率和中心误差。

| 表3 跟踪算法的平均帧率 Tab. 3 Average overlap rate of the tracking algorithms |

|

5 结 论

L1跟踪算法精度不高且因计算量大而速度较慢,为此本文提出一种在线低秩稀疏表示的鲁棒视觉跟踪算法。首先该方法充分利用PCA基向量表示目标的能力,以PCA基模板描述目标外观,以琐碎模板处理遮挡或噪声;然后根据粒子间的潜在关系和单个粒子的特性,对目标模板系数进行低秩稀疏约束,对琐碎模板系数实施稀疏约束,提高了跟踪的精确度;最后基于重构误差和误差矩阵建立观测模型,并采用遮挡检测机制对目标模板进行更新,克服了模型漂移问题。在粒子滤波框架下结合上述几个方面实现了本文的跟踪算法。与其他4个跟踪算法在8组图像序列上进行了实验验证,实验结果表明:本文提出的算法具有更好的跟踪准确性,并对光照变化、局部遮挡、运动模糊、杂乱背景等具有较好的鲁棒性。由于本算法的跟踪速度较慢,在接下来的研究中会进一步优化算法以解决计算复杂度问题,并尝试在GPU上实施CUDA加速或结合硬件FPGA等,以满足跟踪的实时性。

| [1] |

Kalal Z, Mikolajczyk K, Matas J. Tracking-learning-detection[J]. IEEE Transactions on Pattern Analysis and Machine Intelligence, 2012, 34(7): 1409-1422. DOI:10.1109/TPAMI.2011.239 |

| [2] |

Zhong W, Lu H C, Yang M H. Robust object tracking via sparse collaborative appearance model[J]. IEEE Transactions on Image Processing, 2014, 23(5): 2356-2368. DOI:10.1109/TIP.2014.2313227 |

| [3] |

Zhang Lin, He Xiaohai. An anti-occlusion tracking method based on particle filter[J]. Journal of Sichuan University (Engineering Science Edition), 2014, 46(1): 135-139. [张琳, 何小海. 基于粒子滤波的抗遮挡跟踪算法[J]. 四川大学学报(工程科学版), 2014, 46(1): 135-139.] |

| [4] |

Wu Yi,Lim J,Yang M H.Online object tracking:A benchmark[C]//Proceedings of IEEE Conference on Computer Vision and Pattern Recognition,Portland:IEEE,2013.

|

| [5] |

Mei Xue,Ling Haibin.Robust visual tracking using L1 minimization[C]//Proceedings of IEEE 12th International Conference on Computer Vision,Kyoto:IEEE,2009.

|

| [6] |

Bao Chenglong,Wu Yi,Ling Haibin,et al.Real time robust L1 tracker using accelerated proximal gradient approach[C]//Proceedings of IEEE Conference on Computer Vision and Pattern Recognition,Rhode Island:IEEE,2012:1830–1837.

|

| [7] |

Jia X,Lu H C,Yang M H.Visual tracking via adaptive structural local sparse appearance model[C]//Proceedings of IEEE Conference on Computer Vision and Pattern Recognition,Providence RI:IEEE,2012:1822–1829.

|

| [8] |

Xiao Ziyang, Lu Huchuan, Wang Dong. L2-RLS based object tracking[J]. IEEE Transaction on Circuits and Systems for Video Technology, 2014, 24(8): 1301-1309. DOI:10.1109/TCSVT.2013.2291355 |

| [9] |

Zhang Tianzhu,Ghanem B,Liu Si,et al.Low-rank sparse learning for robust visual tracking[C]//Proceedings of Conference on European Conference on Computer Vision.Berlin:Springer,2012.

|

| [10] |

Wang Haijun, Ge Hongjuan, Zhang Shengyan. Object tracking via online low rank representation[J]. Journal of Xidian University, 2016, 43(5): 112-118. [王海军, 葛红娟, 张圣燕. 在线低秩表示的目标跟踪算法[J]. 西安电子科技大学学报, 2016, 43(5): 112-118.] |

| [11] |

Ross D A, Lim J, Lin R S. Incremental learning for robust visual tracking[J]. International Journal of Computer Vision, 2008, 77(1/2/3): 125-141. |

2017, Vol. 49

2017, Vol. 49