日益严重的车行道路环境灾害,使得车辆环境感知的避险技术研究受到人们的高度重视,而针对恶劣天气条件的车辆机器视觉感知技术研究是其中的重点,尤其在雾霾或雨雾视频图像清晰化处理方面的理论技术是该领域研究的一个热点。然而,交通车行场景中视频图像去雾的恢复处理,是一个实时性极强的不确定逆问题,车行环境中能见度与可视距离的时变性使不少理论技术成果要走向实用化还有相当距离。

目前,利用图像增强和基于物理模型是两类主要的去雾方法。但图像增强法不考虑图像降质的本质原由,仅从增加图像对比度和凸显有用细节入手,虽然在一定程度上有去雾的效果,但丢失了很多细节信息,未能从根本上解决图像降质问题。基于物理模型是当前广为使用的一种去雾方法,He等[1]提出的暗原色先验理论,在物象亮度接近天空光亮度时,这种基于统计规律得出的先验去雾法将失效;对此,陈书贞等[2]引入混合通道结合全变差正则化(full variation regularization)方法对暗原色法进行改进,但其暗通道阈值T和亮度L难以确定;龙伟等[3]通过改进暗原色算法精细化透射率,减少暗原色先验透射率粗糙引起的Halo效应和边缘残雾,但是通过引导滤波在暗原色图中去求取透射率会消耗大量的时间;刘国等[4]引入了一个合适的阈值K来限定透射率的取值范围,避开了引导滤波求取透射率的时间复杂度,对单幅图像达到了自适应去雾;李炎炎等[5]针对恶劣交通环境下行车安全,提出了基于车行视程的视频快速去雾处理,此方法在能见度选取正确情况下可获得较好的去雾效果,但车行环境的时变性使得这种方法的实用性受到限制。为此作者通过二分法求根协同BRISQUE评价指标自动估值当前车行环境的能见度值,利用能见度与车行可视距离的关系函数求取透射率,对车载视频进行自适应的去雾处理。

1 简化大气衰减模型早期,Nayer[6]和Narasimhan[7]等在雾霾图像退化的物理模型基础之上,提出了现目前广泛应用的大气散射模型:

| $E = {I_\infty }\gamma {{\rm e}^{{\rm{ - }}\beta {d_{x}}}} + {I_\infty }(1 - {{\rm e}^{{\rm{ - }}\beta {d_{x}}}})$ | (1) |

式中,

依据大气辐照的原理

| ${J_{x}} = {I_\infty } + \frac{{E - {I_\infty }}}{{{t_{x}}}}$ | (2) |

式中,

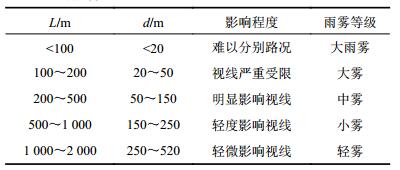

经研究统计发现,一定条件下能见度与车行可视距离之间存在着函数关系,而这种特定的条件在车辆交通环境中通常有如表1的划分标准[5]。

| 表1 能见度L与可视距离d关系 Tab. 1 Relationship between visibility and visibility distance |

|

2.1 透射率估值

李炎炎等[5]提出了基于车行视程的透射率估值模型。它反映了透射率受大气能见度与车行可视距离共同影响:

| ${t_{x}} = {{\rm e}^{ - \frac{{3.912}}{L}d}}$ | (3) |

式中:L为雾天下的能见度,m;d为场景深度,也被称为可视距离。基于透射率表达式,若假定目标物象景深不发生变化,随着雾气浓度的加深,视野能见度将会下降,当能见度下降到几乎不能看清前方物体时,即

| ${t_{x}} = 1 - \frac{{{t_{x\max}} - {{\rm e}^{ - \frac{{3.912}}{L}d}}}}{{{t_{x\max}}}}$ | (4) |

利用最小二乘法原理对能见度与场景深度进行线性回归处理,推导出回归公式:

| $d = \overline d + (L - \overline L )\frac{{\displaystyle\sum\limits_{i = 1}^n {({L_i} - \overline L )d} }}{{\displaystyle\sum\limits_{i = 1}^n {{{({L_i} - \overline L )}^2}} }}$ | (5) |

式中,

| $d = a \cdot L + 2.255$ | (6) |

式中,

| ${t_{x}} = \frac{{{{\rm e}^{(0.5L + 4.410\;8) \cdot {{10}^{ - 3}}}}}}{{{{\rm e}^{{{(L + 8.821\;6)}/L}}}}}$ | (7) |

线性1次拟合得到的透射率值在恢复图像时会出现颜色过于饱和、去雾不完全等问题。对此本文重新推导可视距离与能见度关系表达式。经过3次拟合得到如下关系式:

| $\begin{aligned}[b] d =\; & 0.544\;81 \times L - 0.000\;368{L^2} + \\ & 1.185\;2{{\rm e}^{ - 7}}{L^3} - 45.181\;5 \end{aligned} $ | (8) |

将式(8)代入式(4),得到新的透射率估值表达式:

| ${t_{x}} = \frac{{{{\rm e}^{1.066 \times {{10}^{ - 3}}L - 7.198 \times {{10}^{ - 7}}{L^2} + 1.292 \times {{10}^{ - 3}}{L^3} - 0.088}}}}{{{{\rm e}^{2.131 - 1.440 \times {{10}^{ - 3}}L + 2.584{L^2} - {{176.75}/L}}}}}$ | (9) |

由于从雾霾图像转换成灰度图并没有清除图中的雾气,所以直接将其作为大气光图的估计并不会产生十分明显的去雾效果,所以需要先对含雾图像的灰度图进行处理,再获取大气光值[8]。引导滤波是通过一个局部线性模型来平滑的过滤掉灰度图像中的雾气,同时能够保持图像的边缘信息。在该模型中,输入图像为E,引导图像为I,滤波后输出图像为q,在以k为中心像素的邻域窗口

| ${q_i} = {a_k}{I_i} + {b_k},\quad {\forall i \in {\omega _k}}$ | (10) |

式中,

| $\mathop {\min}\limits_{({a_k},{b_k})} \sum\limits_{i \in {\omega _k}} {[{{({q_i} - {e_i})}^2} - \varepsilon a_k^2]} $ | (11) |

为防止线性变换系数

| ${a_k} = \dfrac{{\dfrac{1}{{\left| \omega \right|}}\displaystyle\sum\limits_{i \in {\omega _k}} {{I_i}{e_i} - {\mu _k}{{{\overline e}_k}} } }}{{\sigma _k^2 + \varepsilon }}$ | (12) |

| ${b_k} = {{\overline e}_k} - {a_k}{\mu _k}$ | (13) |

式中,

由于每个像素点会包含在多个领域窗口

| $\begin{aligned}[b] & {a_k} = \frac{1}{{\left| \omega \right|}}\sum\limits_{k,i \in {\omega _k}} {({a_k}{I_i} + {b_k}) = {{\overline a}_i} } {I_i} +{{\overline b}_i},\\ & \overline {{a_i}} = \frac{1}{{\left| \omega \right|}}\sum\limits_{k \in {\omega _k}} {{a_k}} {{\overline b}_i} = \frac{1}{{\left| \omega \right|}}\sum\limits_{k \in {\omega _k}} {{b_k}} \end{aligned}$ | (14) |

以原始雾霾图像作为输入图,通过引导滤波获得滤波输出图像

| ${I_\infty } = \left(\frac{1}{{\left| \omega \right|}}\sum\limits_{k \in {\omega _i}} {{a_k}}\right){E_i} + \frac{1}{{\left| \omega \right|}}\sum\limits_{k \in {\omega _i}} {{b_k}} $ | (15) |

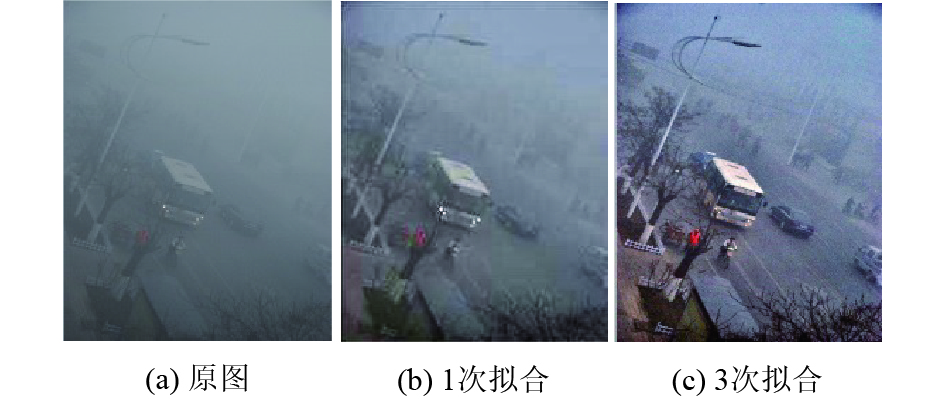

图1是利用引导滤波获取的雾霾图像大气光值,分别结合1次拟合与3次拟合得到的透射率值恢复雾霾图像的效果对比。

|

| 图1 不同透射率值恢复效果 Fig. 1 Different transmittance values restore effect |

显然,3次拟合后得到的透射率值相比于1次拟合得到的透射率值在处理雾霾图像上去雾更彻底、细节信息保留更完整。

3 二分法自动估值能见度车行视程去雾算法透射率的获取需要当前环境下的能见度值,目前,能见度观测方法主要有两类[9]:器测法和目测法。器测法主要使用透射仪和向前散射仪,但设备庞大不能满足车行环境的便携性要求。而目测法主观性强、规范性差,即使能估计到大气能见度值,但在车辆高速行驶的状况下频繁的人为调节能见度值以获得清晰地视频图像也是非常的危险。针对上述情况,作者提出了一种基于改进的非线性求根二分法模型,通过自动的估计当前行车环境下的能见度值,以获取最佳视频图像,避免了人机交互时对行车安全造成影响。

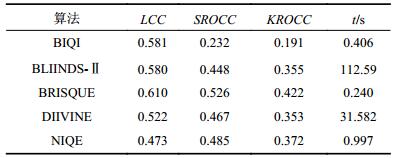

3.1 无参考图像空域质量评价(BRISQUE)改进的二分法主要通过判断能见度在20~2 000 m范围内,不同能见度值下的图像清晰化效果,筛选出去雾效果最佳的图像。但在无参考图像情况下,准确客观地评价图像质量好坏是一个科学难题。对近几年在非特定失真的无参考图像评价体系中广为使用的5种方法做了性能对比[10]:

表2中各种算法分别为:盲图像质量指数(BIQI)[11]、DCT统计信息盲图像完整性指数(BLIINDS-Ⅱ)、盲/无参考图像空域质量评价(BRISQUE)[12–13]、基于失真辨识的图像真实性和完整性评价(DIIVINE)[14]、自然图像质量评价(NIQE)[15]。评价算法精确度的指标为:线性相关系数(LCC)、Spearman秩相关系数(SROCC)、Kendall秩相关系数(KROCC)。3种衡量指标值越大,说明评价算法与人眼视觉主观性越匹配,反之则偏离。因此选用性能最优且费时最少的BRISQUE评价指标作为本文判断车行视程能见度的基础,其值越小反映图像质量越好。

| 表2 算法平均性能 Tab. 2 Average performance of algorithms |

|

3.2 二分法筛选能见度值的过程

交通环境中通常认定能见度在2 km时物景光线完全透射,能见度低于20 m时,视线被完全阻隔。据此条件,以能见度

| $L_{\rm c}' = {L_{\min }}\left\{ {{B_{(L_i')}},{B_{({L_i})}},{B_{(L_{\rm c})}}} \right\}$ | (16) |

式中,

| ${T_i} = \frac{{{T_{i - 1}}}}{2}$ | (17) |

| $\left\{ {\begin{aligned} & {{L_i} = {L_{\rm c}} - {T_i}},\\ & {L_i' = {L_{\rm c}} + {T_i}} \end{aligned}} \right.$ | (18) |

式中,

车行环境中,假设车辆以法规规定的最高时速120 km/h行驶,即每秒通行距离为33 m。实验中,对每帧像素为

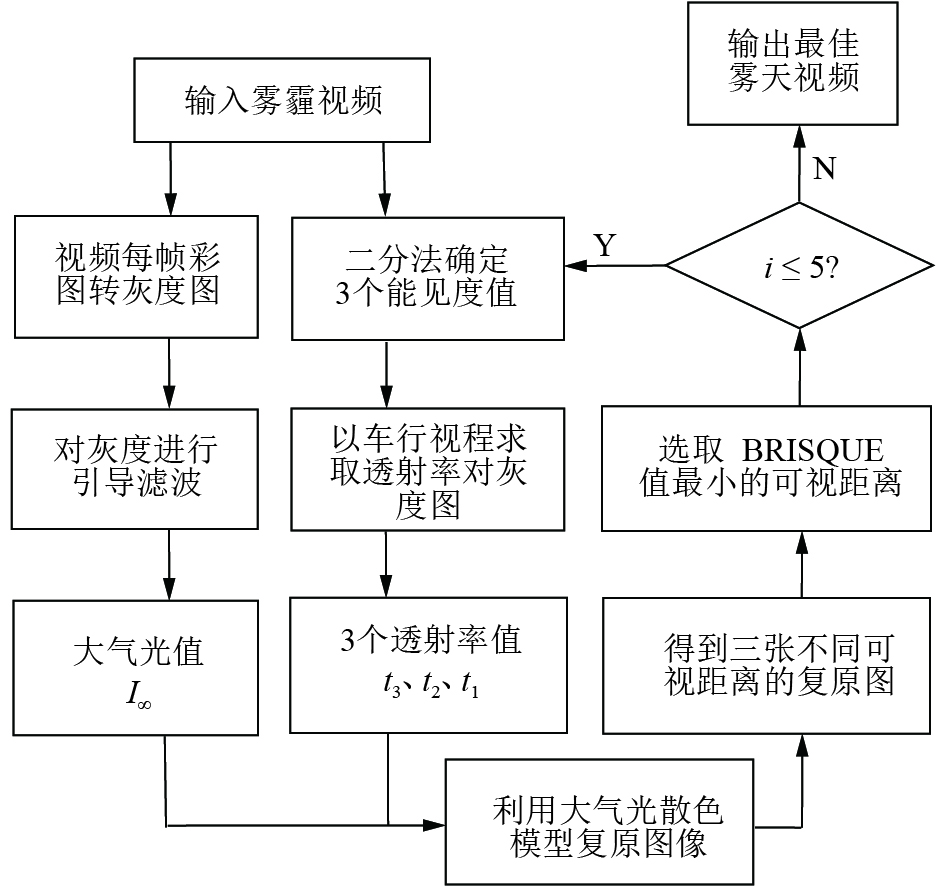

为了验证本文算法效果,随机截取雾霾视频处理之后的1帧图像,采用平均梯度、信息熵和BRISQUE等评价标准与原图所包含的信息量、细节反差表达能力、清晰度进行比较。同时,用Brial SWS–200天气能见度仪采集得到的实际能见度值与实验反馈得到的能见度值作比较,直观了解实验偏差。去雾流程如图2所示。

|

| 图2 去雾流程 Fig. 2 Flow of defogging algorithm |

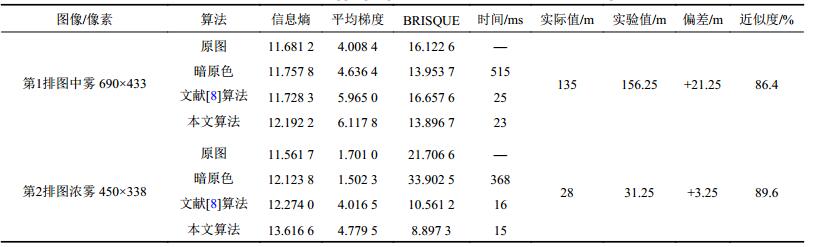

| 表3 不同去雾算法效果与耗时 Tab. 3 Different defogging algorithm effects and time-consuming |

|

|

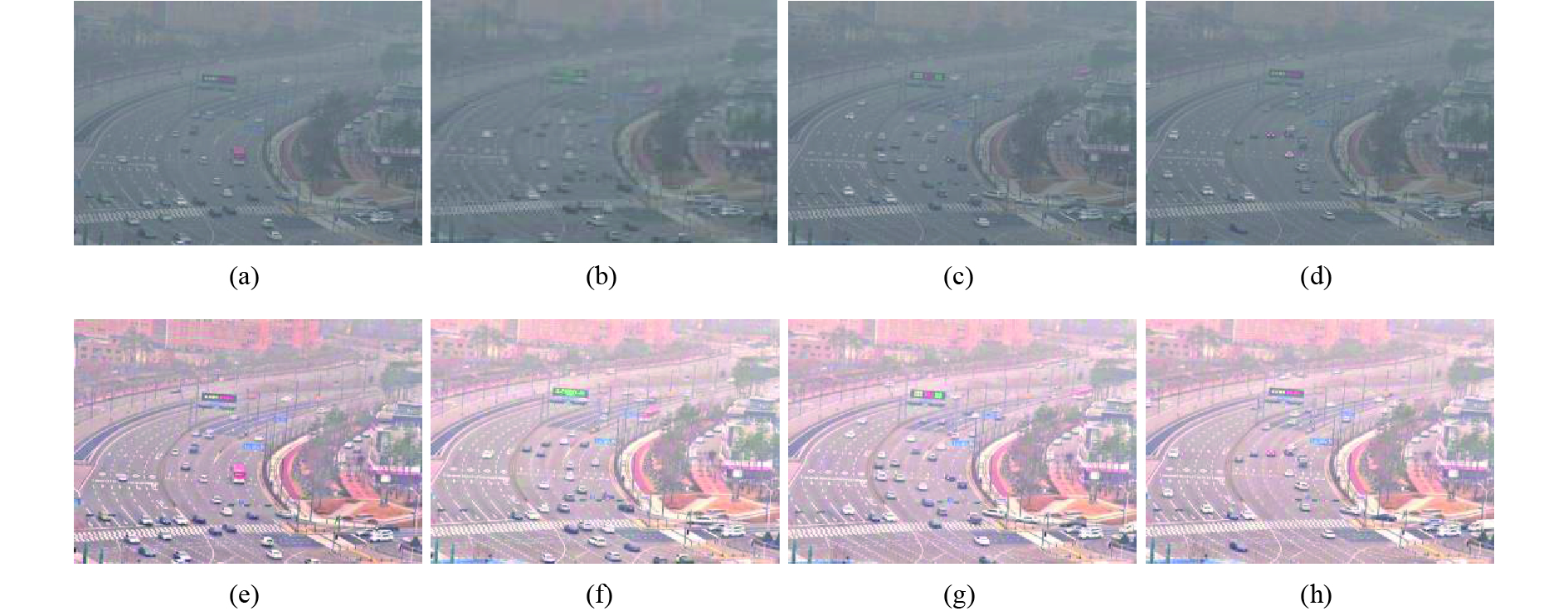

| 图3 视频去雾截图 Fig. 3 Video defogging screenshot |

图3的视频去雾处理截图中,He算法去雾后的图像整体偏暗且细节信息损失较为严重,由于暗原色算法复杂度高,处理每帧图像上的耗时远远超过了24帧法规定的时间,所以这种方法不适于用来处理视频图像。对于文献[5]提出的算法,虽在每帧图像处理的耗时上达到了视频处理的要求,但是在红色方框标注的地方比本文算法处理的图像有更多的光晕出现,在第2排图中还有去雾不完全、细节信息丢失等情况出现。表3中信息熵描述了图像的平均信息,值越大表示包含的信息量越多。平均梯度反映了图像对细节的表达能力,值越大说明图像越清晰。实验表明,本文算法处理的图像在各项评价指标上均有很好表现,且在处理速度上也很快。为进一步说明本文去雾的算法和自动获取的最佳图像算法可行并且处理效果显著,对一段雾天下的交通监控视频进行连续去雾处理,随机取出处理后的帧图像与原始视频图像作对比,结果如图4所示。

|

| 图4 雾天交通监控视频序列去雾效果截图 Fig. 4 Sketch of defogging effect of video sequence of traffic monitoring in foggy weather |

图4中第1排为原始视频序列,第2排为使用本文算法去雾后对应的视频序列。在第2幅视频序列图中,雾气浓度出现了较大变化,通过二分法短时间内找到最佳能见度值进行去雾处理,处理后的图像仍能有很好的清晰度,整个过程流畅无卡顿。

5 结 论作者提出的视频去雾自适应算法,很好地解决了基于车行视程的车载视频去雾算法能见度难以获取的问题,使视频图像保持最清晰的状态。虽然本算法获取的能见度在恢复视频图像取得了很好的效果,但与能见度仪测量的能见度值之间还是有一定的误差,后续还需要对算法进行一定的优化,使得能见度估值更加准确。

| [1] |

He K,Sun J,Tang X. Single image haze removal using dark channel prior[J]. IEEE Transactions on Pattern Analysis and Machine Intelligence, 2011, 33(12): 2341-2353. DOI:10.1109/TPAMI.2010.168 |

| [2] |

陈书贞,任占广,练秋生. 基于改进暗通道和导向滤波的单幅图像去雾算法[J]. 自动化学报, 2016, 42(3): 455-465. |

| [3] |

龙伟,傅继贤,李炎炎,等. 基于大气消光系数和引导滤波的浓雾图像去雾算法[J]. 四川大学学报(工程科学版), 2016, 48(4): 175-180. |

| [4] |

刘国,吕群波,刘扬阳. 基于自适应暗原色的单幅图像去雾算法[J]. 光子学报, 2018, 47(2): 179-186. |

| [5] |

李炎炎,龙伟,覃宏超,等. 基于车行视程与大气光快速估值的车载视频去雾算法[J]. 工程科学与技术, 2017, 49(3): 217-222. |

| [6] |

Nayar S K,Narasimhan S G.Vision in bad weather[C]//Proceedings of the 7th IEEE International Conference on Computer Vision.Keryara:IEEE,1999,2:820–827

|

| [7] |

Narasimhan S G,Nayar S K. Vision and the atmo-sphere[J]. International Journal of Computer Vision, 2002, 48(3): 233-254. DOI:10.1023/A:1016328200723 |

| [8] |

覃宏超,李炎炎,龙伟,等. 基于引导滤波和暗原色先验理论透射率估值的视频去雾算法[J]. 浙江大学学报(工学版), 2018, 52(7): 1302-1309. |

| [9] |

许茜,殷绪成,李岩,等. 基于图像理解的能见度测量方法[J]. 模式识别与人工智能, 2016, 26(6): 543-551. |

| [10] |

王志明. 无参考图像质量评价综述[J]. 自动化学报, 2015, 41(6): 1062-1079. |

| [11] |

Moorthy A K,Bovik A C. A two-step framework for constructing blind image quality indices[J]. IEEE Signal Processing Letters, 2010, 17(2): 513-516. |

| [12] |

Mittal A,Moorthy A K,Bovik A C. No-reference image quality assessment in the spatial domain[J]. IEEE Transactions on Image Processing, 2012, 21(6): 222-228. DOI:10.1109/TIP.2012.2214050 |

| [13] |

Saad M A,Bovik A C,Charrier C. Blind image quality assessment:A natural scene statistics approach in the DCT domain[J]. IEEE Transactions on Image Processing, 2012, 21(8): 3339-3352. DOI:10.1109/TIP.2012.2191563 |

| [14] |

Moorthy A K,Bovik A C. Blind image quality assessment:From natural scene statistics to perceptual quality[J]. IEEE Transactions on Image Processing, 2011, 20(12): 3350-3364. DOI:10.1109/TIP.2011.2147325 |

| [15] |

Mittal A,Soundararajan R,Bovik A C. Making acompletely blind image quality analyzer[J]. IEEE Signal Processing Letters, 2013, 20(3): 209-212. DOI:10.1109/LSP.2012.2227726 |

2019, Vol. 51

2019, Vol. 51